YouTubeは、プラットフォーム上でのAI生成コンテンツとディープフェイクの増加に対処するための措置を講じています。透明性を維持し、コミュニティを保護するために、動画共有プラットフォームは今後数ヶ月でいくつかの変更を実施する予定です。

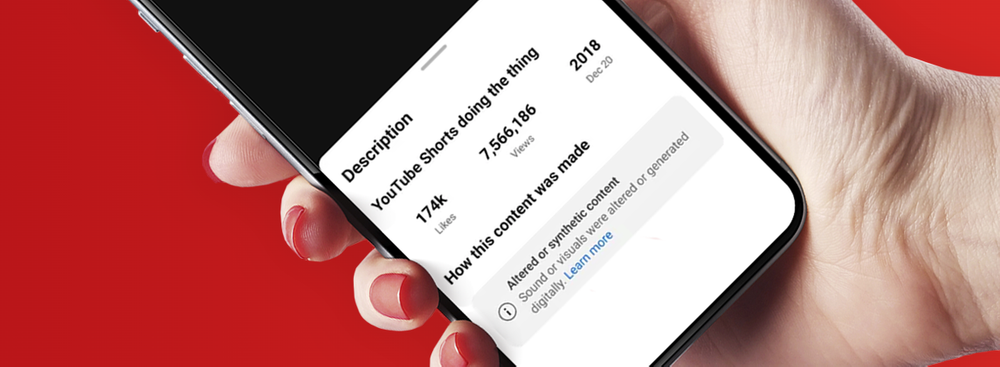

一つの重要な変更点は、AI生成コンテンツのラベリングです。クリエイターは、人工知能を使用して「リアリスティック」なコンテンツ(存在しなかった出来事を描くビデオや、行動を取っていない個人を描くビデオを含む)を制作した際にこれを開示する必要があります。これらの開示は、特に選挙や公衆衛生危機などの敏感なトピックに関して、ビデオの説明およびビデオプレーヤー自体に表示されます。

AI生成コンテンツを正確にラベリングしない場合、コンテンツの削除、YouTubeパートナープログラムからの一時停止、またはその他の制裁が課される可能性があります。YouTubeは、クリエイターがこれらの新しい要件を理解し、遵守できるように密接に協力することを目指しています。しかし、「リアリスティックな」AI生成コンテンツの定義は難しく、YouTubeはより具体的なガイダンスと例を提供するために取り組んでいます。

プラットフォームはまた、識別可能な個人(顔や声を含む)をシミュレートするビデオの削除を視聴者が要求できるようにする予定です。このプロセスには、コンテンツがパロディや風刺としての資格があるか、または個人が公人であるかどうかなど、さまざまな要素を評価することが含まれます。

これらの変更は、ディープフェイクを含むAI生成コンテンツの使用が増加していることへの対応策として行われ、プラットフォーム上での創造性の促進とコミュニティの安全性の維持のバランスを取ることを目指しています。YouTubeは、責任ある革新を創造するため、クリエイターやアーティスト、その他のステークホルダーと協力し続けることを強調しています。